生成AI 児童ポルノ画像を学習か 専門家「被害者の人権侵害恐れ」

画像生成AI(人工知能)の精度を上げるための学習に使われる膨大な画像データの中に、国立国会図書館が「違法な児童ポルノの恐れがある」として閲覧を禁じた写真集の一部が含まれていることがわかった。データの中にはほかにも児童の裸の画像が複数あった。ネットから収集する過程で紛れ込んだとみられる。学習する際、違法画像を取り除くフィルター機能があるが、排除しきれていないという。

画像生成AIは、文章を入力すると、イラストや写真のような画像を作り出す。最も人気が高い画像生成AIの一つ「ステーブル・ディフュージョン(SD)」が学習に使うデータセット(データ群)はネット上で公開されていた。読売新聞が昨年12月、内容を調べた結果、1993年に出版された裸の少女を写した写真集の画像データが見つかった。

読売新聞 2024/03/21 05:00

出版当時は規制する法律がなかったが、18歳未満の性的画像の公開などを禁じた児童買春・児童ポルノ禁止法が施行された99年以降、こうした写真集の公開は違法になった。国会図書館は2006年、この写真集を「児童ポルノに該当する恐れがある」として閲覧を禁止していた。データセットの中にはほかにも児童の裸の画像データが複数あった。

https://www.yomiuri.co.jp/national/20240321-OYT1T50036/

配布される生成AIは学習データ公開を義務付けるしかないな

実在しない人物に人権なんてないだろ

それは生成の段階の話だろロリコン爺

死霊のはらわた裁判で虚構の人物の尊厳にも保護が必要であるという判例が出ている

国会図書館は関係ないだろ

主語をずらすマスゴミの詭弁

データセットを公開してたところ(ドイツ)が問題なんであって

生成AI作ったところとは別の国・組織だし生成AIだけに使われてるデータセットでもない

AIの絵はみんな同じ顔で苦手だわ…

まあこうなるのは分かってたけどもう遅いわな

児ポ画像を生成させてそれを学習元にされたモデルが出たら本来の学習元なんて闇の中だし

昔あったロリコン雑誌とか国会図書館に山ほどあるんだってな

今と違って芋臭いけど可愛い少女のくぱぁとか国会図書館うらやましい

別に問題ないだろ

つまりテイラー・スイフトの顔を真似て整形したら人権侵害の加害者になるの?

生成AIドラマやアニメが後5年もすれば溢れ出す

2年前から流行り始めた画像生成AIの時は、ゲーミングちんぽが真っ先にトレンド入りしてたからな

人間が作ってる以上、エロが原動力になるのは必然

そのうち昔の画質の悪いエロ動画が高画質リマスター版となって出回るんやろうな。

とにかくAIにケチ付けて規制したい奴らがいるんだろう

司法とか士業とか

AIに置き換わった方がいい職業はいくらでもある

税理士とかの士業はマジでAI で対応出来るし寧ろ優秀だからな

あと役所関係

成人の裸はニーズ無いらしいな

ロリじゃなくても儲けるにはロリとかになるみたい

被害者誰?

学習された人

児童の体を児童の体として学習させないと成人との区別つけられないし、精度を上げるための学習ってそういうことじゃないの?

摘発に使うならそういうのも必要だろうな

著作権がどうとかいうのもあるけど始まっちゃったもんは仕方がないとしか言いようがないわな

どうしても規制したいんだろうけど

ロリ画像は単純所持も違法だからな

学習データの中に入ってたら配布した人はロリ画像配布してるのと同じ

性的興奮~とあるから判断は恣意的になりやすい

読売新聞が昨年12月、内容を調べた結果

ヒマなのかこいつら

こういう風に悪用する人間の差のせいでAI技術発展が遅れる

完全な害悪

子供の肉体を弄びながら

異端尋問をしていたカトリックみたい

AIにエッチなのは駄目だと教えればいいやろ

お前らの化身

むかし流行ったwarezやら違法画像動画を分割してアップロードして結合させるのと、やってることは変わらんな

パスワードがAIに指示する言葉になってるだけで

まぁ私的利用に限るで終わらせるんじゃね

低年齢武勇伝(犯罪告白&前科持ち)になるだけだろ

検討違いな生成AI擁護が笑える

昔に撮られた未成年の危ない写真があるのが問題って話でしょ

エロが画像AI牽引してるのに変な横槍入れんなや

無法地帯でいいんだよ

eつまり読売新聞は児ポを所持したって自白したのか

AI絵は盗品の山だしもっとやったれ!

自由に学習させてやれよ。

細々と公開してた以上節度をもって楽しめという状態になっていたと判断せざるをえない

AI君は限度知らずに広めるからなあ…

そしてこれが、少子高齢化を加速することを、専門家たちは知るよしもなかった

仮に紛れていたとしてなんの法律に触れてるの?

学習自体は合法でしょ

>読売新聞が昨年12月、内容を調べた結果、

>1993年に出版された裸の少女を写した写真集の画像データが見つかった

こいつら体育系で、ロクに取材もできくせに、

こういうことだけは、キチンとやらかすのなw

これ言い出したら、少しでも犯罪を犯したことのある法学者が関わった法律は全部間違ってるってことになってしまう

学習セットから減算する機能つけたらいいんじゃないの?

幼ポだけでなく危険なものは沢山あるので出力しないようにAIを制御するしかない

どうせデジタルのデもわからんバカ議員が

プチエンジェル事件のときの画像流出させちゃっただけだろ

生成AIやってる奴の大半が

エロ目当て?

実在の子供を学習して生成したならアウトだろ

世界がイスラム教みたいになってきたな

実在しない絵の人権よりも

今、実際に生きている子供たちの人権を、もっと尊重しろよ

AIの危険性って物理的に核兵器乗っ取られて云々じゃなくてネット上の情報が全て信用出来なくなる事だよね

文章も写真も動画も

検索でエロ画像探してるとAI画像がバンバン引っかかるようになってウザいのなんの

やってることは昔からあるアイコラと変わらん

進歩せんな

何が悪いの?

AIにも表現の不自由があるのか

|

引用元:https://5ch.net/

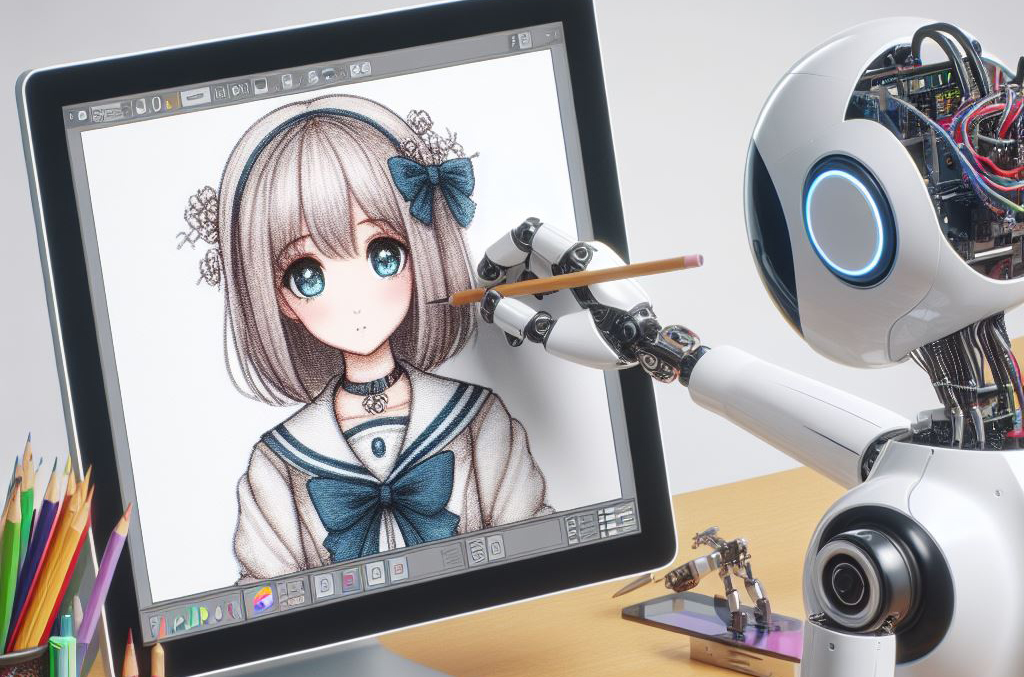

イラスト提供:Copilot

コメント

ロリだけである必要なくない?